基于双流类自适应网络的半监督高光谱图像分类

原文:《Dual-Stream Class-Adaptive Network for Semi-Supervised Hyperspectral Image Classification》

摘要

半监督遥感高光谱图像(HSI)分类旨在利用有标签和无标签样本进行准确的土地覆盖识别。然而,数据分布不平衡和不同的分类难度会对分类性能产生负面影响。针对这个问题,本文提出了一种用于半监督HSI分类的新型双流类自适应网络(DSCA-Net)。首先,引入了一个超像素引导有标签传播(superpixel-guided label propagation, SGLP)模块来减轻数据分布不平衡的负面影响。具体来说,通过超像素级别的相似性度量和有标签传播来实现对无标签样本有标签的近似估计,从而对每个类别应用相同的采样。然后,构建了一个基于一致性正则化的双流网络,该网络共享相同的编码器来表示有标签或无标签样本的特征。在此基础上,设计了两个不同的分类器来强制对同一无标签样本的不同增强版本进行类似的预测,从而允许无标签样本以监督方式训练模型。最后,由于不同的类别总是有着不同的学习难度,相同的处理方式可能会导致“易”类过拟合和“难”类预测偏差。与传统使用固定阈值选择无标签样本不同,本文根据模型的学习状态计算动态的类自适应阈值。通过这种方式,为“易”类分配更高的阈值以减少样本冗余,并为“难”类设置更低的阈值以选择更多样本。实验结果证明了所提出方法的有效性和优越性。代码可在https://github.com/luting-hnu/DSCA-Net上获得。

主要思路

当训练样本不足时,监督学习的性能会受到负面影响。为了减少对有标签样本的依赖,一些深度学习方法开始探索在高光谱图像

(HSI) 分类任务中使用半监督学习(SSL)策略 [23, 24, 25,

26]。具体来说,SSL 方法通过同时利用有标签和无标签样本,来提升性能

[27]。SSL

方法可以大致分为三大类:基于生成式模型、基于图论方法和自训练方法。其中,生成式模型旨在通过自编码器(AE)模型获取无标签样本的上下文信息。例如,Zhou

等人 [28] 分别使用两个堆叠的自编码器对 HSI

的光谱和空间特征进行预训练,然后使用 SSL

共训练的方式扩大了初始训练集。Jia 等人 [29]

分别集成了一个自编码器模块和一个孪生网络,用于挖掘大量无标签数据中的信息,然后利用有限的有标签样本集进行微调。基于图的方法通过捕获有标签和无标签样本共同揭示的内在结构来实现分类目标。Kotzagiannidis

和 Schönlieb [30] 提出了一种用于高光谱图像分类的多级边缘高效 SSL

图形网络,该网络通过在图构建中嵌入伪标签特征来利用有标签样本。Xi 等人

[31]

提出了一种新的跨尺度图原型层,以增强半监督高光谱图像分类的节点特征和原型的判别力和代表性。自训练方法则需要迭代更新高可信度的无标签样本(即伪标签),并与少量有标签样本结合来训练分类器

[32]。Feng 等人 [33]

提出了一种半监督长尾学习方法,该方法基于空间邻域信息确定无标签样本的有标签,并使用新的标准重新确定它们以提高伪标签的准确性。然而,生成式模型需要适当的约束来生成高度可信的伪标签样本,这在实践中很难满足。基于图的方法可以很好地构建有标签和无标签样本之间的连接用于有标签传播,但这通常需要大量计算。相比之下,自训练方法由于其简单原理和良好的性能而被广泛研究。

基于以上分析,我们本文尝试设计一种基于 CNN

模型和自训练方法的新型半监督深度学习方法。本文旨在解决两个主要问题,即数据分布不平衡和不同类别学习难度差异。在自训练方法中,需要随机选择一部分数据作为无标签样本集(ULS)。然而,由于数据分布总是存在不平衡性

[34],数量较少的类别可能不会被选中,从而导致分类的偏差估计。此外,自训练格式为了选择高可信度的伪标签样本,需要设置一个较高的阈值,通常会设置为

0.95 等高值 [35]。然而,事实上,不同类别应该具有不同的学习难度

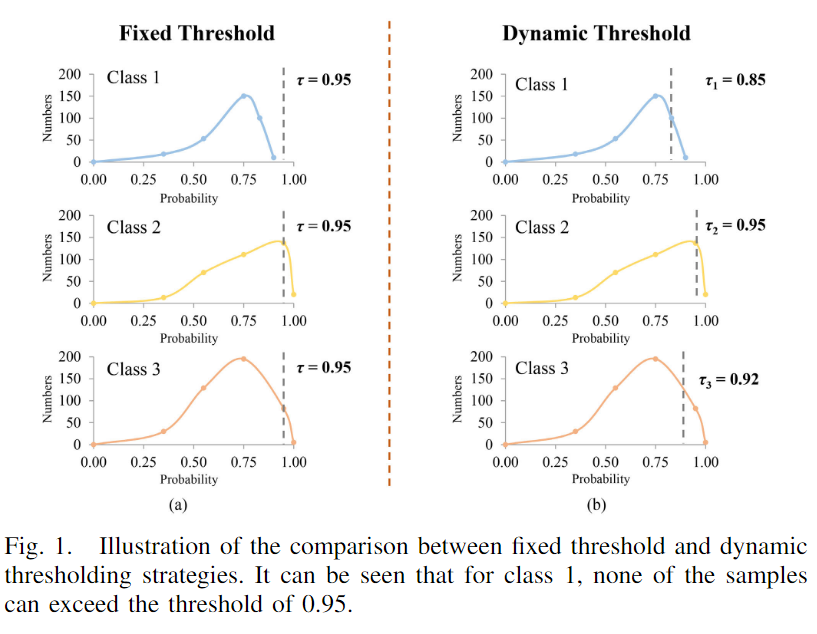

[36]。如下图 1(a)

所示,对所有伪标签样本设置相同的阈值,会导致对于学习难度高的类别,只有少量样本甚至没有样本能够超过如此高的阈值。相比之下,正如示意图

1(b) 所示,不同的类别需要具有动态的类适应型阈值。  针对数据分布不平衡和不同类别学习难度带来的负面影响,我们提出了一种用于半监督高光谱图像分类的新型双流类适应型网络(DSCA-Net)。首先,为了缓解数据分布不平衡的问题,我们提出了一种超像素引导有标签传播

(SGLP)

模块,该模块通过基于超像素的相似性测量和标签传播来传播已知标签,为后续训练提供类别平衡的无标签训练集。在过去的遥感图像分类研究中,基于超像素的技术被证明是非常有用的。例如,Zhao

等人 [37]

提出了一种超像素引导的可变形卷积方法,可以根据高光谱图像的空间结构自适应地提取特征。Jia

等人 [38]

则提出了一种无需任何参数调优的超像素级加权标签传播方法。之前的方法旨在在超像素层面实现连续迭代的特征学习或标签更新,但这需要大量的计算。与这些工作不同,我们提出的模块在网络训练之前只进行一次余弦相似度测量和标签传播,因此计算量较低。然后,通过一致性正则化,我们设计了两个不同的分类器,以强制对同一无标签样本的不同增强版本做出相似的预测,从而使无标签样本能够以监督方式训练模型。最重要的是,传统固定阈值方法(即为每个类别设置相同的阈值)存在不足之处

[39]。为此,我们提出了一种类别自适应动态阈值(CADT)策略。该策略根据模型的学习状态计算难度估计,并由此获得每个类别的对应阈值。此外,我们设计了一个非线性映射函数,将难度估计值映射到每个类别的最终自适应阈值。综上所述,我们方法的主要贡献如下:

针对数据分布不平衡和不同类别学习难度带来的负面影响,我们提出了一种用于半监督高光谱图像分类的新型双流类适应型网络(DSCA-Net)。首先,为了缓解数据分布不平衡的问题,我们提出了一种超像素引导有标签传播

(SGLP)

模块,该模块通过基于超像素的相似性测量和标签传播来传播已知标签,为后续训练提供类别平衡的无标签训练集。在过去的遥感图像分类研究中,基于超像素的技术被证明是非常有用的。例如,Zhao

等人 [37]

提出了一种超像素引导的可变形卷积方法,可以根据高光谱图像的空间结构自适应地提取特征。Jia

等人 [38]

则提出了一种无需任何参数调优的超像素级加权标签传播方法。之前的方法旨在在超像素层面实现连续迭代的特征学习或标签更新,但这需要大量的计算。与这些工作不同,我们提出的模块在网络训练之前只进行一次余弦相似度测量和标签传播,因此计算量较低。然后,通过一致性正则化,我们设计了两个不同的分类器,以强制对同一无标签样本的不同增强版本做出相似的预测,从而使无标签样本能够以监督方式训练模型。最重要的是,传统固定阈值方法(即为每个类别设置相同的阈值)存在不足之处

[39]。为此,我们提出了一种类别自适应动态阈值(CADT)策略。该策略根据模型的学习状态计算难度估计,并由此获得每个类别的对应阈值。此外,我们设计了一个非线性映射函数,将难度估计值映射到每个类别的最终自适应阈值。综上所述,我们方法的主要贡献如下:

- 我们提出了一种用于高光谱图像分类的新型双流半监督深度学习网络。具体来说,该网络中的两个流共享相同的编码器以获取相似的特征表示,并采用两个分类器进行不同的标签估计。通过联合优化监督和非监督交叉熵损失,网络模型可以学习来自有标签和无标签样本的更具判别性的特征。

- 为了减轻数据分布不平衡的负面影响,我们设计了一个 SGLP 模块,用于快速生成所有无标签像素的可能标签的近似估计。基于相似度测量,将有限的已知标签逐个超像素地进行传播。根据这一点,我们可以从每个类别中选择相同数量的无标签样本构建平衡的 ULS。

- 为了自适应地确定阈值以更好地选择具有高置信度的伪标签样本,这里提出了一种 CADT 策略。考虑到不同类别具有不同的学习难易度,我们评估它们的分类难度,并利用评估值来调整阈值。这有助于缓解“容易”类别的过度拟合和“困难”类别的偏差预测。

本文方法

首先,首先,DSCA-Net 通过精心设计的 SGLP

模块挑选无标签样本,以减轻数据分布不平衡带来的负面影响。其次,我们利用一致性正则化

[40]

的概念构建了一个双流结构,该结构可以为同一无标签样本的不同增强版本生成相似的预测。最后,考虑到不同类别具有不同的学习难度,我们设计了

CADT

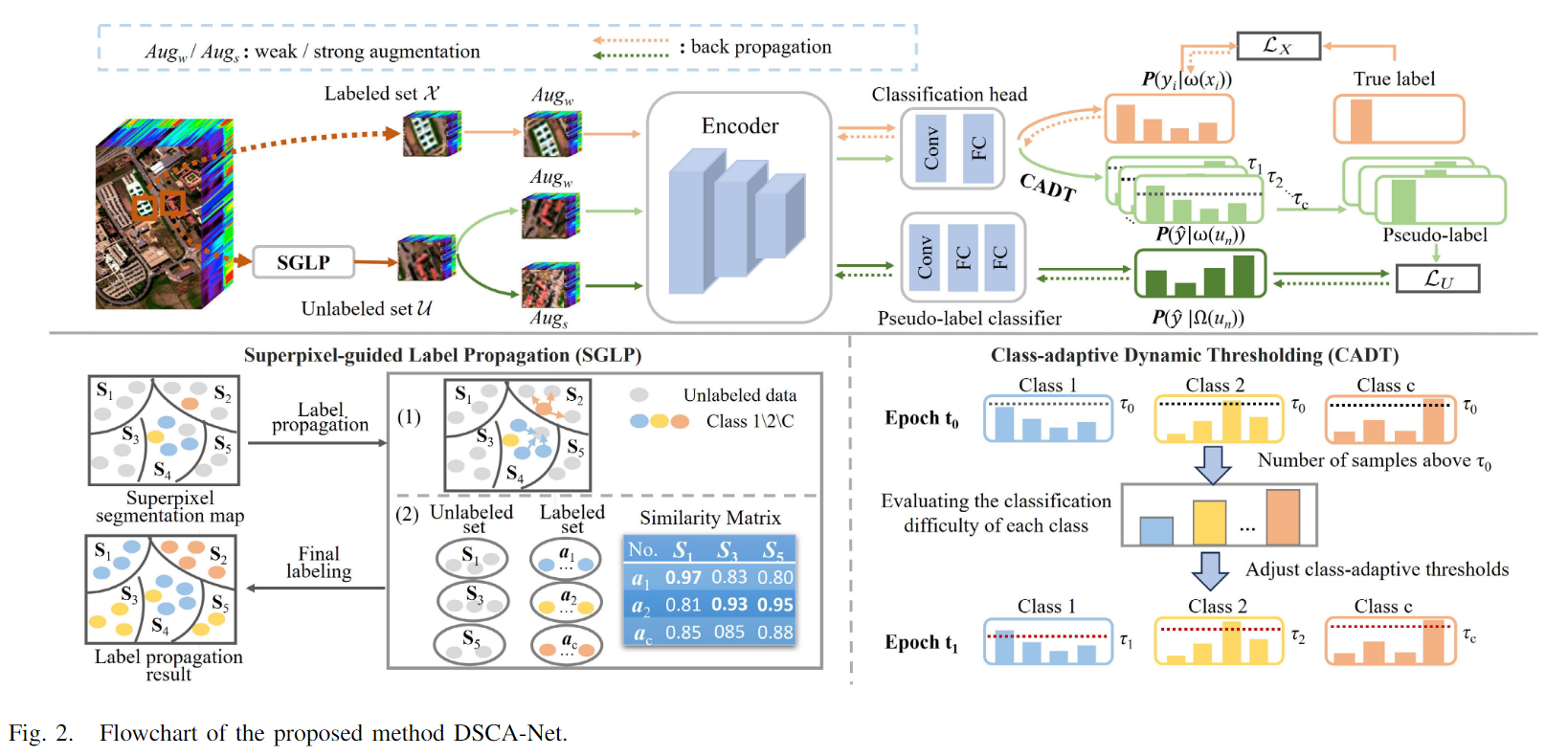

策略来自适应地调整阈值,以实现可靠的样本选择。也就是说,为“简单”类分配更高的阈值,反之亦然。最终的分类网络通过使用混合损失函数对无标签样本进行迭代学习来优化。所提出方法的流程图如图

2 所示。详细描述如下。

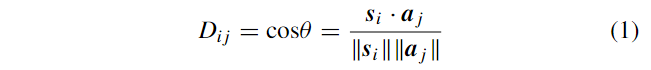

超像素引导有标签传播(SGLP)

由于数据分布不平衡,随机选择无标签样本会导致非平衡采样,因此对于 SSL

来说,合理选择无标签样本非常重要。为了减轻不平衡分布的负面影响,本节介绍了

SGLP

模块。即,我们在基于光谱-空间相似性的超像素分割的指导下,将有限的已知标签样本传播到整个高光谱图像(HSI)。利用这些传播的标签,可以实现不同类别的均衡采样。本文中,我们使用简单线性迭代聚类(SLIC)[41]

将高光谱图像(HSI)分割成一组超像素。这些超像素是非重叠的同质区域,形状和大小各异。然后,根据超像素内是否包含有标签样本,可以将它们分为两组。如图

2 所示,一组包含带有已知标签样本的超像素,例如  其中

其中

补充:

超像素 (Superpixel): 图像中具有相似颜色和纹理的像素组

超像素引导标签传播算法

超像素引导标签传播算法是一种结合超像素和标签传播的半监督学习算法。该算法的步骤如下:

- 将图像分割成超像素。

- 对每个超像素分配一个初始标签。

- 计算每个超像素与相邻超像素的相似度。

- 根据相似度传播标签。

- 重复步骤 3 和 4,直到标签收敛。

超像素引导标签传播算法的优点

- 可以有效地利用超像素信息来提高标签传播的准确性。

- 可以减少图像的复杂性,提高算法的效率。

- 可以应用于各种图像分类任务。

基于一致性正则化的双流结构

一致性正则化 [42]

是一种用于训练无标签样本的灵活策略,其核心思想是对于同一个无标签样本的不同增强版本,模型应该输出相似的预测结果。为了充分利用无标签样本进行训练,我们构建了一个具有一致性正则化的双流结构。其中之一是监督流,另一个是非监督流。这两个流分别使用弱增强函数

其中,

其中,

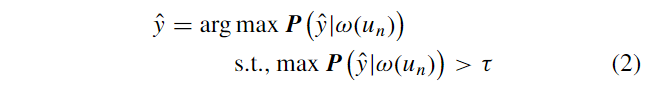

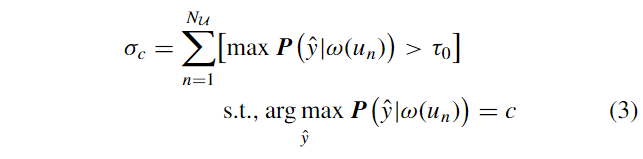

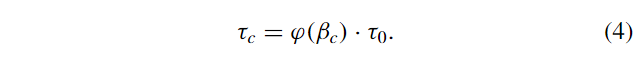

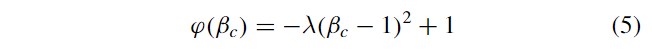

类别自适应动态阈值

正如上一节所述,阈值  其中,

其中, 根据公式 (4),阈值

根据公式 (4),阈值  其中,

其中,

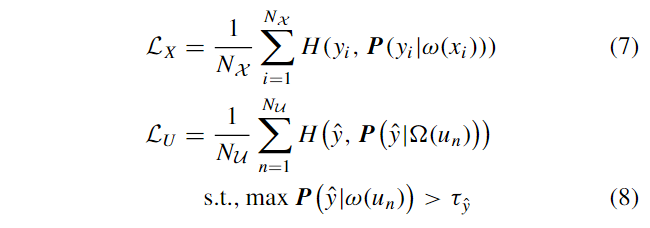

总体损失

DSCA-Net 的损失函数由两部分组成:有标签样本的监督交叉熵损失

其中,

其中,